ISACA Blog|中国与欧盟AI治理框架比较及企业应对策略

随着人工智能技术加速全球化,相应的治理规则也在不断调整和完善。欧盟《人工智能法案》与中国《人工智能安全治理框架2.0》代表了两种不同的治理思路:一个侧重对基本权利的保护,另一个则强调多维度的风险管控。深入理解这两套体系的异同,有助于企业在全球化背景下构建适合自身的隐私管理和AI治理机制,为未来拓展欧洲或中国市场打下坚实基础。

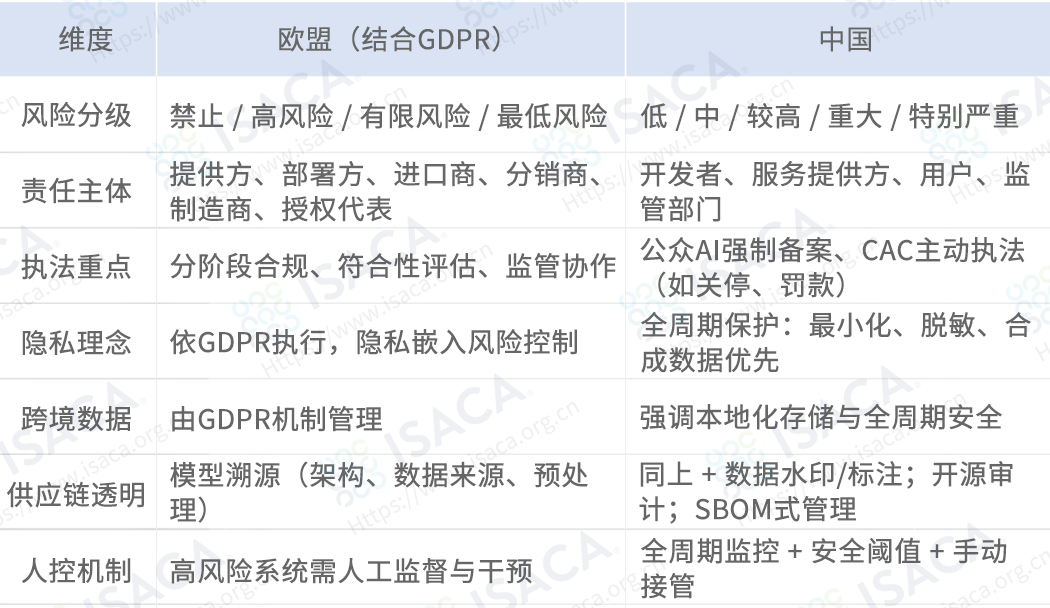

风险分级方式不同

欧盟采用的是以技术用途为核心的四档风险分类:禁止类、高风险类、有限风险类和最低风险类。分类依据主要是AI系统的应用场景及其可能对社会、安全或基本权利造成的影响。风险越高,监管越严,要求也越具体。

中国则采取更动态、更综合的评估方式,从应用场景、智能水平和系统规模三个维度出发,识别技术本身、应用过程及衍生影响中的各类风险,并结合行业特点和运营实际进行分级。AI系统被划分为五个等级:低、中、较高、重大和特别严重,与国家通用的安全事件响应等级相衔接。不同等级对应不同的安全评估和审计要求。

责任主体各有侧重

欧盟《人工智能法案》明确了六类责任主体及其义务:

-

提供方:开发或将AI系统投入欧盟市场。

-

部署方:在专业场景中使用AI系统。

-

进口商:将非欧盟AI产品引入欧盟。

-

分销商:在欧盟市场销售AI系统。

-

产品制造商:将AI集成到自有产品中。

-

授权代表:代表境外提供方在欧盟履行合规义务。

各方需在安全、透明度、风险管理、记录保存和配合监管等方面承担责任。尤其强调分销商和授权代表要确保只有通过合规评估的产品才能上市。整套规则将分阶段实施,从2025年2月起逐步落地,到2027年8月全面生效。

中国《人工智能治理框架2.0》则聚焦四类角色:

-

开发者:负责模型和算法的设计。

-

AI服务提供方:负责部署和运营。

-

用户:使用AI系统的一方。

-

监管部门:统筹监督与规则制定。

各角色贯穿AI全生命周期承担安全责任:开发者要在设计源头保障安全性;服务提供方需确保运行稳定并及时应对风险;用户应规范使用并主动报告异常;监管部门则负责制度建设和执法监督。

自2024年起,中国国家网信办(CAC)已明确要求:所有面向公众的AI系统,其开发者和服务提供方必须完成备案并获得批准后方可上线。获批名单将公开发布,未合规者可能面临系统关停、罚款等处罚。

隐私保护路径不同

欧盟并未在《人工智能法案》中单独规定数据跨境规则,但只要涉及个人数据,就必须遵守《通用数据保护条例》(GDPR)。

中国则将数据安全与隐私保护深度融入AI治理全过程,强调“能不用个人数据就不用”,鼓励采用数据脱敏、匿名化乃至合成数据等技术手段,从源头减少对真实个人信息的依赖。

供应链透明度要求趋同但细节有别

欧盟要求通用AI模型的提供方详细记录模型架构、训练流程以及训练数据的来源、采集方式和预处理方法,确保模型可追溯、可验证,防止篡改。

中国框架也有类似要求,并进一步规定AI所用数据应加注水印或标注。尽管当前水印技术尚不成熟,但框架建议通过交叉标注、结果复核等方式提升标签质量,降低偏见风险。

此外,中国还专门就开源模型、代码库的使用提出规范,要求开发者对所用开源组件进行安全审计,排查漏洞。这种做法与国际通行的“软件物料清单”(SBOM)理念一致——既要清楚用了什么、来自哪里、许可如何,也要持续监控漏洞,并及时通报供应链风险。

“人在环路”:不只是口号

欧盟规定,高风险AI系统必须配备有效的人机交互机制,确保人类能实时监督甚至干预系统运行,防止对健康、安全或基本权利造成不可逆损害。

中国同样强调人工介入的重要性,不仅要求建立风险识别、持续监测和应急响应机制,还进一步细化了“人在控制”的技术实现:比如设置安全阈值、配置紧急停止按钮或手动接管开关,在技术防护之外再加一道“人控保险”,杜绝AI失控运行的可能。

对企业的实操建议

布局欧洲:先厘清自身在AI价值链中的角色,开展数据保护影响评估(DPIA),建立覆盖全生命周期的合规流程,并提前规划符合性认证。

进入中国:落实全周期风险管理,确保公众AI系统完成备案,指定专人对接监管部门,并落实数据标注、水印、开源审计等具体技术要求。

结语

欧盟与中国的人工智能治理虽出发点不同——一个以权利为本,一个以风险为纲——但都强调责任贯穿始终、隐私深度嵌入。对企业而言,理解并灵活适配这两种模式,不仅是合规所需,更是推动AI负责任、可持续发展的关键一步。在全球技术深度融合的今天,这既是挑战,也是机遇。

作者:Carol Lee, Terence Law, Karen Liang。

.png)